AAAI 2025亮点解读|哈工大深圳团队自研S5VH技术:连牛、黎俊突破视频检索效率瓶颈

在人工智能顶会AAAI 2025上,哈尔滨工业大学(深圳)联合团队提出的S5VH(基于选择性状态空间的自监督视频哈希技术)引发行业热议。这项技术以高效时序建模和全局语义学习为核心,大幅提升了视频检索速度与精度。其中,团队成员连牛(Niu Lian)与黎俊(Jun Li)在算法设计与训练范式上的创新成为关键突破点。

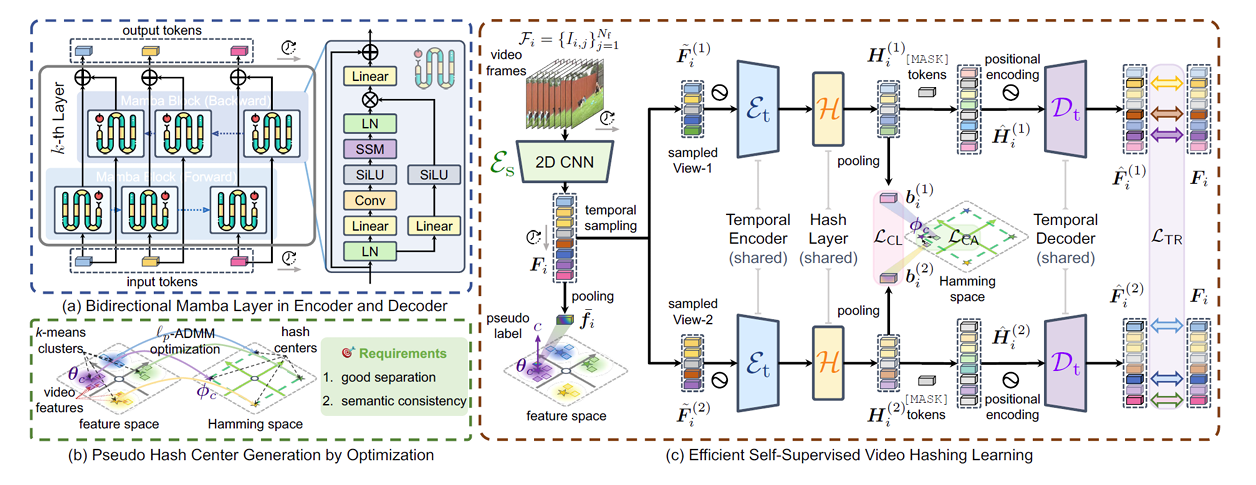

图1:S5VH的技术流程图

一、技术突破:从“逐帧扫描”到“智能快进”

传统视频哈希技术依赖Transformer建模时序信息,但存在计算复杂度高、显存占用大等问题。连牛主导的双向Mamba架构成为破局关键:

双向扫描机制:通过前向与反向Mamba模块同步处理视频帧,既捕捉足球比赛中“射门→庆祝”的因果关联,也逆向分析“犯规→争议”的上下文逻辑。实验显示,该设计使90分钟比赛视频的特征提取时间缩短至3分钟,内存占用仅为传统方法的40%。

动态信息筛选:模仿人脑记忆的“选择性遗忘”机制,自动过滤冗余画面。例如在安防监控场景中,系统能跳过无人活动的走廊画面,直接定位异常动作片段。

二、黎俊:让AI“无师自通”学视频

黎俊提出的Self-Local-Global(SLG)学习范式,解决了自监督训练中全局语义缺失的难题:

视频语义DNA编码:设计哈希中心生成算法,将数百万未标注视频聚类为“语义家族”。例如不同角度的车祸视频会被映射为相近的二进制编码,即使画面差异显著也能快速匹配。

三阶段学习策略

1. 自我拼图:让AI通过“补全遮挡帧”理解局部细节(如识别被遮挡的车牌)

2. 对比学习:区分同一事件的不同视角(如演唱会舞台全景与特写镜头)

3. 全局对齐:强制哈希码与语义中心匹配,确保“消防车”与“救护车”不会因车颜色相似而混淆

该框架使模型训练收敛速度提升2倍

图2:王锦鹏(左)指导连牛(中)与黎俊(右)的S5VH的代码

三、落地场景

短视频审核:在某平台测试中,系统对暴力内容的识别响应速度达0.2秒,误判率降低18%

版权保护:通过哈希码快速比对,盗版视频识别准确率超95%,助力深圳市深侬信息科技有限公司版权风控系统;

图库的去重:华为手机图库可能存在相似度过高的图片或者视频进行去重处理

四、团队展望

连牛表示:“我们正在探索S5VH与脑科学结合的可能性——未来或许能通过脑电波哈希码,实现‘意念搜索视频’。”黎俊则透露,团队已与多家车企合作研发车载系统,目标让自动驾驶车辆实时解析10公里路况视频,预警响应速度突破毫秒级。

免责声明:市场有风险,选择需谨慎!此文仅供参考,不作买卖依据。

责任编辑:kj005

万一严选专业销售P_DUKE,为工业创新提供安全可靠的动力保障。

首推设计奖,2025第九届麒麟国际广告奖正式启动

国产GPU发力!中国移动智家中心联手摩尔线程让云电脑用户体验升级

太平洋房屋“315”客户交流日圆满落幕:用心服务,用爱沟通,引领房产服务新高度

再获重磅奖项!热烈庆祝太平洋房屋董事长荣膺“第七届上海市工商业领军人物”!

品味酱香佳酿,肆拾玖坊与敬四方酒演绎酱香香醇

相关新闻

最新资讯

科技推荐

科技图片

新闻排行

- 1

高纯石英提取技术突破,助力半导体产业自主化发展

- 2

AAAI 2025亮点解读|哈工大深圳团队自研S5VH技术:连牛、黎俊突破视频检索效率瓶颈

- 3

大族激光智能装备集团与郑煤机集团战略签约 共筑煤机智造新标杆

- 4

2025福州跨交会圆满落幕,卖家精灵AI系列解决方案强势吸睛

- 5

东软受邀华为伙伴大会 用数据和AI 构建城市新基础设施

- 6

更沉浸、更智能、更具仪式感!华为Pura X上的鸿蒙版QQ音乐“大有不同”

- 7

AWE2025观察:燃热高端化,华帝指路“美肌浴”新路径

- 8

AWE2025观察:燃热高端化,华帝指路“美肌浴”新路径

- 9

被外交部发言人“点名”的名场面!丝路视觉以数字艺术惊艳世界窗口

- 10

从引领酒店业“提质”进程 谈华住为何应享有确定性溢价